由于DeepSeek全球使用量太多,导致服务器经常出现过载情况,本文介绍如何使用硅基流动 (Siliconflow)平台和开源软件 Cherry Studio 绑定DeepSeek R1 API接口 ,云端部署DeepSeek R1 671B 完全体模型。

快捷导航

1. 注册Silconflow 硅基流动平台

注册硅基流动平台:点击注册可获赠2000万Tokens(相当于14元配额)

上面的活动是平台发起的,邀请注册均可获得奖励,体验silconcloud.

1. 模型广场介绍

全量模型 deepseek-ai/DeepSeek-R1

点击模型广场,第一个 deepseek-ai/DeepSeek-R1就是满血版的Deepseek,这里大家知道就可以了,此步骤无需操作,后面会有大模型选择,选择R1即可。

蒸馏模型作为备选方案:

蒸馏模型参数数量更小,算力需求少,运行速度更快,可以使用下图中 Deepseek-ai/DeepSeek-R1-Distill-Llama-70B 模型(70B)

以上我们只做模型广场的了解,下面开始DeepSeek云端部署。

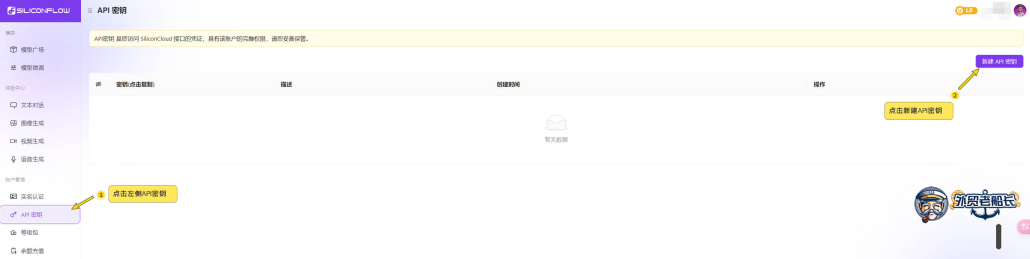

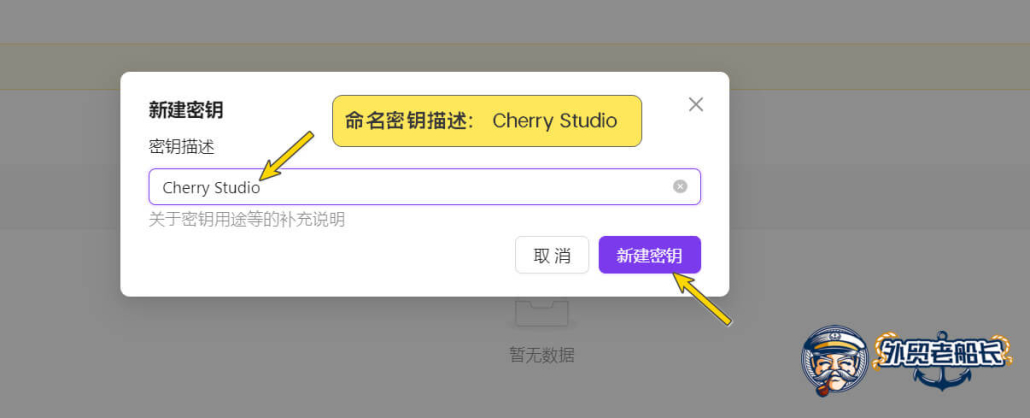

2. 建立API密钥

点击左侧API密钥,然后建立API密钥,并对密钥进行命名,举例: Cherry Studio。

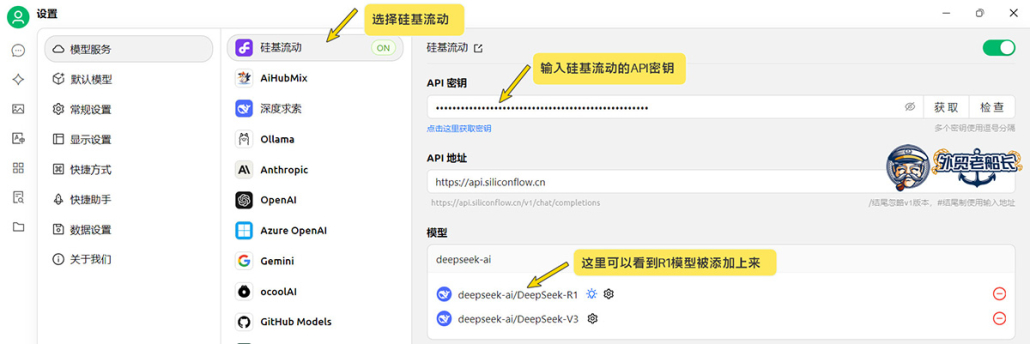

2. Cherry Studio 安装与配置

1. 什么是Cherry Studio?

Cherry Studio是一款跨平台的AI聊天客户端,集成了多个大型语言模型(LLM)提供商的服务,如OpenAI,Gemini,Anthropic,DeepSeek等,并支持Ollama本地模型部署。Cherry Studio还提供了丰富的文档与数据处理功能,支持文本、图像、办公文件、PDF等格式。

2. Cherry Studio 安装与配置

登录Cherry Studio平台下载软件并安全,下载地址:https://cherry-ai.com/download

下载后进行安装即可,可能会有防御软件提示,点击允许执行即可。

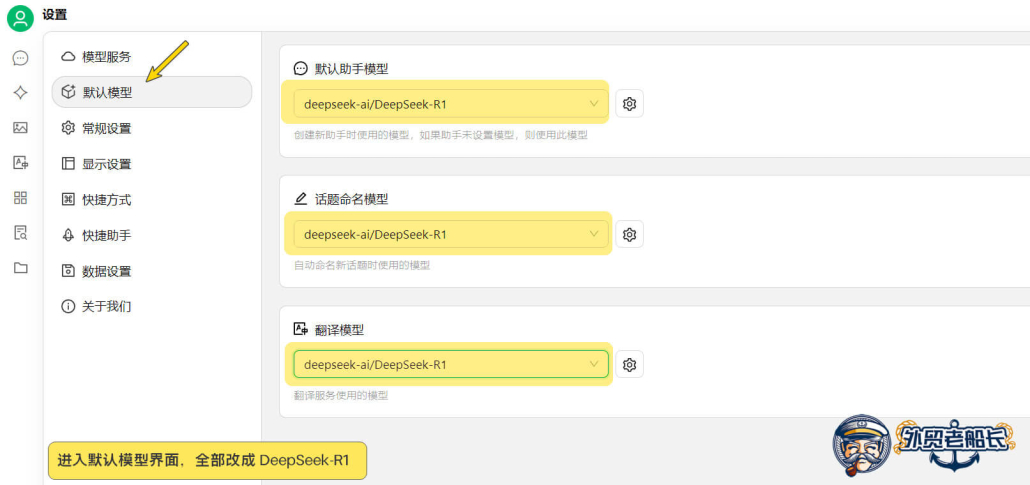

3. 设置默认模型是DeepSeek-R1

点击左下方齿轮按钮进入设置界面,选择“默认模型”,将默认助手模型,话题命名模型,翻译模型 都调整成Deepseek-ai/DeepSeek-R1。

4. 检查目前使用模型

在Cherry Studio顶部可以看到目前你使用的语言模型。

5. 查看你目前Tokens使用和花费

在硅基流动平台左侧的【费用账单】>【费用明细】,可以看到Tokens的用量和消费总额,新人用户注册会送14元的额度,2000万Tokens免费使用,不用担心很快就消耗完,祝大家使用愉快并利用好创造价值。

老船长贴士:

- 查询一次不是使用一个Tokens,而是词元,比如每个单词或者词组就是一个Tokens。

- DeepSeek属于推理模型,使用混合专家模型技术,我认为更有利于网站的优化操作,就像是我们在做关键词分析用户潜在的搜索意图一样。